Проблемы линейных регрессионных моделей, Предпосылки метода наименьших квадратов (условия Гаусса-Маркова) - Моделирование в эконометрике

- 1. Предпосылки метода наименьших квадратов. 2. Проблема мультиколлинеарности. 3. Гомоскедатичность и гетероскедатичность. Линейные регрессионные модели с гетероскедатичными и автокоррелированными остатками. 4. Регрессионные модели с переменной структурой (фиктивные переменные)

Предпосылки метода наименьших квадратов (условия Гаусса-Маркова)

- 1. Математическое Ожидание Случайного Отклонения Равно Нулю Для Всех Наблюдений. Данное условие означает, что случайное отклонение в среднем не оказывает влияния на зависимую переменную. В каждом конкретном наблюдении случайный член может быть либо положительным, либо отрицательным, но он не должен иметь систематического смещения. 2. Дисперсия Случайных Отклонений Постоянна Для Любых Наблюдений. Это условие подразумевает, что несмотря на то, что при каждом конкретном наблюдении случайное отклонение может быть либо большим, либо меньшим, не должно быть некой априорной причины, вызывающей большую ошибку (отклонение).

Выполнимость данной предпосылки называется гомоскедастичностью (постоянством дисперсии отклонений). Невыполнимость данной предпосылки называется гетероскедастичностью (непостоянством дисперсии отклонений).

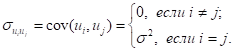

3. Случайные Отклонения UI И UJ Являются Независимыми Друг От Друга Для Ij. Выполнимость данной предпосылки предполагает, что отсутствует систематическая связь между любыми случайными отклонениями. Другими словами, величина и определенный знак любого случайного отклонения не должны быть причинами величины и знака любого другого отклонения. Выполнимость данной предпосылки влечет следующее соотношение:

Поэтому, если данное условие выполняется, то говорят об отсутствии автокорреляции.

4. Случайное Отклонение Должно Быть Независимо От Объясняющих Переменных.

Обычно это условие выполняется автоматически, если объясняющие переменные не являются случайными в данной модели. Данное условие предполагает выполнимость следующего соотношения:

5. Модель Является Линейной Относительно Параметров.

Теорема Гаусса-Маркова. Если предпосылки 1-5 выполнены, то оценки, полученные по МНК, обладают следующими свойствами:

- 1) Оценки являются несмещенными, то есть М(b0) = 0, М(b1) = 1, где b0, b1) - коэффициенты эмпирического уравнения регрессии, а 0, 1 - их теоретические прототипы. Это вытекает из первой предпосылки и говорит об отсутствии систематической ошибки в определении положения линии регрессии. 2) Оценки состоятельны, так как дисперсия оценок параметров при возрастании числа n наблюдений стремится к нулю. Другими словами, при увеличении объема выборки надежность оценок увеличивается (коэффициенты теоретического и эмпирического уравнений регрессии практически совпадают). 3) Оценки эффективны, то есть они имеют наименьшую дисперсию по сравнению с любыми оценками данных параметров, линейными относительно величин yI.

Если предпосылки 2 и 3 нарушены, то есть дисперсия отклонений непостоянна и (или) значения случайных отклонений связаны друг с другом, то свойства несмещенности и состоятельности сохраняются, но свойство эффективности - нет.

Наряду с выполнимостью указанных предпосылок при построении классических линейных регрессионных моделей делаются еще некоторые предположения. Например:

- - объясняющие переменные не являются СВ; - случайные отклонения имеют нормальное распределение; - число наблюдений существенно больше числа объясняющих переменных.

Одним из условий регрессионной модели является предположение о линейной независимости объясняющих переменных, т. е., решение задачи возможно лишь тогда, когда столбцы и строки матрицы исходных данных линейно независимы. Для экономических показателей это условие выполняется не всегда. Линейная или близкая к ней связь между факторами называется Мультиколлинеарностью и приводит к линейной зависимости нормальных уравнений, что делает вычисление параметров либо невозможным, либо затрудняет содержательную интерпретацию параметров модели. Мультиколлинеарность может возникать в силу разных причин. Например, несколько независимых переменных могут иметь общий временной тренд, относительно которого они совершают малые колебания. В частности, так может случиться, когда значения одной независимой переменной являются датированными значениями другой. Считают явление мультиколлинеарности в и сходных данных установленным, если коэффициент парной корреляции между двумя переменными больше 0,8. Чтобы избавиться от мультиколлинеарности, в модель включают лишь один из линейно связанных между собой факторов, причем тот, который в большей степени связан с зависимой переменной.

- - В качестве критерия мультиколлинеарности может быть принято соблюдение следующих неравенств: - RYxi > RXixk, RYxk > RXixk, RXixk < 0,8. - если приведенные неравенства (или хотя бы одно из них) не выполняются, то в модель включают тот фактор, который наиболее тесно связан с Y.

Похожие статьи

-

В большинстве реальных больших систем не обойтись без учета "состояний природы" -- воздействий Стохастического типа, случайных величин или случайных...

-

Нелинейные модели регрессии - Моделирование в эконометрике

Нелинейные модели регрессии и их линеаризация. 1. Типы нелинейных моделей: 2. Нелинейные модели линейные по объясняющим переменным и их линеаризация. 3....

-

Линейная модель парной регрессии - Моделирование в эконометрике

Введение в регрессионный анализ. Модель парной линейной регрессии. 1. Метод наименьших квадратов (МНК). 2. Свойства оценок МНК 3. Модель парной линейной...

-

При невыполнимости предпосылки постоянства дисперсий отклонений гомоскедастичность) последствия применения МНК будут следующими. 1. Оценки коэффициентов...

-

1. Определение параметров модели парной линейной регрессии методом наименьших квадратов 2. Оценка тесноты связи между переменными 3. Оценка качества...

-

Методы наименьших квадратов - Системы эконометрических уравнений, их применение в эконометрике

Как уже отмечалось, разработана масса методов эвристического анализа систем эконометрических уравнений. Они предназначены для решения тех или иных...

-

Суть, причины и последствия автокорреляции. - Моделирование в эконометрике

Одной из предпосылок регрессионного анализа является независимость случайного члена в любом наблюдении от его значений во всех других наблюдениях, т. е....

-

Вычисляют выборочную дисперсию, характеризующую меру разброса опытных данных (x I ; Y I ) вокруг значений регрессии, то есть дисперсию остатков ....

-

Обобщенный метод наименьших квадратов - Моделирование в эконометрике

При наличии гетероскедастичности в остатках рекомендуется традиционный метод наименьших квадратов (МНК) заменять обобщенным методом наименьших квадратов...

-

Прогнозирование в регрессионных моделях - Эконометрика как наука

Моделирование в научных исследованиях стало применяться еще в глубокой древности и постепенно захватывало все новые области научных знаний: техническое...

-

Проблема идентификации. - Моделирование в эконометрике

При переходе от приведенной к структурной форме модели возникает проблема идентификации. Идентификация - это единственность соответствия между...

-

Основные этапы построения эконометрической модели - Моделирование в эконометрике

Построение эконометрической модели является основой эконометрического исследования. Оно основывается на предположении о реально существующей зависимости...

-

Неопределенность - это фундаментальное свойство природы, а еще более (и точнее) - свойство, характеризующее неточность, незамкнутость, неокончательность,...

-

Ранговый метод - Ранговый метод оценивания параметров регрессионной модели

Метод наименьших квадратов широко применяется для оценки параметров линейной регрессии, поскольку достаточно прост в вычислении и при предположении о...

-

Особенности эконометрического метода Эконометрическая модель -- основное понятие эконометрии, экономико-математическая модель, параметры которой...

-

Простая линейная регрессия - Моделирование в эконометрике

Простой регрессией называется односторонняя стохастическая зависимость результативной переменной только от одной объясняющей переменной: Простая линейная...

-

Модели вида, Зависимость - Моделирование в эконометрике

Называются полулогарифмическими моделями. Эти модели также относятся к нелинейным моделям относительно включенных в анализ объясняющих переменных, но...

-

Охарактеризовать виды моделей - Методы линейного программирования

Модель -- это некий новый объект, который отражает существенные особенности изучаемого объекта, явления или процесса. Один и тот же объект может иметь...

-

Парная регрессия на основе метода наименьших квадратов и метода группировок - Основы эконометрики

Парная регрессия Характеризует связь между двумя признаками: результативным и факторным. Аналитически связь между ними описывается уравнениями: Прямой...

-

Теоретическое обоснование математического моделирования - Математические методы и модели в экономике

Коммерческая деятельность в том или ином виде сводится к решению таких задач: как распорядиться имеющимися ресурсами для достижения наибольшей выгоды или...

-

Наличие особых ситуаций на террайне зависит от характеристик его сложности. Ниже приведена возможная классификационная схема характеристик сложности...

-

Ранговый метод оценивания параметров регрессионной модели

Пример кода, вычисляющий результаты эксперимента по сравнинию ранговой оценки, МНК - и МНМ-оценок параметров для модели с гауссовским распределением...

-

Вопросы: 1. Общее понятие о системах одновременных уравнений. 2. Структурная и приведенная формы модели. 3. Проблема идентификации. 4. Оценивание...

-

Построение модели на реальных данных - Ранговый метод оценивания параметров регрессионной модели

Для построения линейной регрессионной модели на основе реальных данных при помощи рангового метода оценивания параметров был выбран достаточно известный...

-

Эконометрические методы могут быть применены в моделировании, имитации и прогнозировании рыночных процессов. Достаточно широко в маркетинге используются...

-

Классификация математических моделей - Математическое моделирование в менеджменте и маркетинге

Математические модели могут быть Детерменированными и Стохастическими . Детерменированные модели - это модели, в которых установлено взаимно-однозначное...

-

Постоянство механизмов. Одно из условий, на которое опирается эконометрическое моделирование, состоит в том, что функциональное соотношение не меняется в...

-

Модель парной линейной регрессии - Математическое описание связи: регрессия, корреляция

Предположим, что у нас есть все основания считать, что два экономических показателя взаимосвязаны. Например, уровень инфляции и уровень безработицы в...

-

Проверить ряд на наличие выбросов методом Ирвина, сгладить методом простой скользящее средней с интервалом сглаживания 3, методом экспоненциального...

-

Структурная и приведенная формы модели. - Моделирование в эконометрике

Система совместных, одновременных уравнений (или структурная форма модели) обычно содержит эндогенные и экзогенные переменные. Эндогенные Переменные...

-

Модели и моделирование - Экономико-математические методы

Одним из основных методов научного познания является эксперимент, а самой распространенной его разновидностью - метод моделирования систем. В процессе...

-

Проблема прогнозирования вероятности банкротства существует уже несколько десятков лет - все началось с работ Ramser, Foster (1931), Fitzpatrick (1932) и...

-

Модели линейного программирования. Основные определения Еще одним классом задач экономико-математического моделирования являются задачи линейного...

-

Метод наименьших квадратов - Основы научных исследований

Пусть проведен однофакторный эксперимент, в котором исследована зависимость У от Х . Установлено, что основные предпосылки регрессионного анализа...

-

Особенности эконометрического метода - Особенности эконометрического метода

Становление и развитие эконометрического метода на методах вычислительной статистики: - на методах парной и множественной корреляции; - выделение тренда...

-

Линейный парный регрессионный анализ - Практические аспекты эконометрического анализа

Линейная парная регрессия характеризуется тем, что: 1) объясненная часть является условным математическим ожиданием MX (Y); 2) уравнение регрессии MX...

-

Модель Бокса и Дженкинса Процедуры оценки параметров и прогнозирования, описанные в разделе Идентификация модели временных рядов, предполагают, что...

-

Например, если изучается модель спроса как соотношение цен и количества потребляемых товаров, то одновременно для прогнозирования спроса необходима...

-

Основные предпосылки регрессионного анализа - Основы научных исследований

Методика РА создана с использованием некоторых предпосылок. Если они не выполняются, то корректное выполнение всех процедур РА приведет к неверным...

-

Вычисление АОЭ рангового метода по отношению к МНК и МНМ позволяет сделать выводы о том, какой метод лучше применять для оценки параметров в моделях с...

Проблемы линейных регрессионных моделей, Предпосылки метода наименьших квадратов (условия Гаусса-Маркова) - Моделирование в эконометрике