Обучение нейронной сети - Исследование метода обратного распространения ошибки для обучения нейронной сети

Самым важным свойством нейронных сетей является их способность обучаться на основе данных окружающей среды и в результате обучения повышать свою производительность. Обучение нейронной сети происходит посредством интерактивного процесса корректировки синаптических весов и порогов.

Существуют два концептуальных подхода к обучению нейронных сетей: обучение с учителем и обучение без учителя. В данной курсовой работе используется метод обучения с учителем.

Обучение нейронной сети с учителем предполагает, что для каждого входного вектора из обучающего множества существует требуемое значение выходного вектора, называемого целевым. Эти вектора образуют обучающую пару. Веса сети изменяют до тех пор, пока для каждого входного вектора не будет получен приемлемый уровень отклонения выходного вектора от целевого.

Алгоритм обратного распространения ошибки:

Инициализировать синаптические веса маленькими случайными значениями.

Выбрать очередную обучающую пару из обучающего множества; подать входной вектор на вход сети.

Вычислить выход сети.

Вычислить разность между выходом сети и требуемым выходом (целевым вектором обучающей пары).

Подкорректировать веса сети для минимизации ошибки (как см. ниже).

Повторять шаги с 2 по 5 для каждого вектора обучающего множества до тех пор, пока ошибка на всем множестве не достигнет приемлемого уровня.

Рассмотрим подробней 5 шаг - корректировка весов сети. Здесь следует выделить два нижеописанных случая.

Случай 1. Корректировка синаптических весов выходного слоя

Определимся, что индексом p будем обозначать нейрон, из которого выходит синаптический вес, а q - нейрон в который входит.

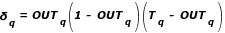

Введем величину д, которая равна разности между требуемым и реальным выходами, умноженной на производную функции активации:

(9)

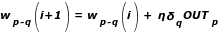

Тогда, веса выходного слоя после коррекции будут равны:

(10)

Где:

I - номер текущей итерации обучения;

- величина синаптического веса, соединяющего нейрон p с нейроном q;

- коэффициент "скорости обучения", позволяет управлять средней величиной изменения весов;

- выход нейрона.

Случай 2. Корректировка синаптических весов скрытого слоя.

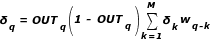

(11)

Где:

- сумма от 1 по N, N - количество нейронов выходного слоя.

Тогда, веса скрытого слоя после коррекции будут равны:

(12)

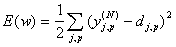

В этом алгоритме происходит распространение ошибки от выходов НС ко входам, то есть в направлении обратном распространению сигналов обычном режиме работы. Согласно методу наименьших квадратов, минимизируемой целевой функцией ошибки НС является величина:

(13)

Где реальное выходное состояние нейрона выходного слоя N нейронной сети при подаче на ее входы - го образа; - желаемое (идеальное) выходное состояние этого нейрона. Суммирование происходит по всем нейронам выходного слоя и по всем обрабатываемым сетью образам.

Чтобы определить оптимальные параметры обучения нейросети данным методом, такие как количество шагов обучения, скорость обучения и коэффициент сигмоида, мы будем анализировать величину ошибки (13). Для этого мы будем использовать среду Matlab.

Мы должны сначала составить таблицы значений ошибки обучения, как функции от 3-х параметров: шага обучения, скорости обучения и коэффициента а в функции активации (7).

План эксперимента:

Коэффициент сигмоиды изменяется от 0 до 10 с шагом 0,1;

Количество шагов обучения - 100;

Так как поверхность является функцией от двух переменных, коэффициент скорости обучения должен быть константой. Поэтому его возьмем равным 3 конкретным значениям: 0,5; 1; 1,5. Тогда функция ошибки будет зависеть от двух параметров, и мы сможем построить ее график.

Анализируя графики, мы сможем выбрать оптимальные значения этих параметров.

Похожие статьи

-

Несмотря на большое разнообразие вариантов нейронных сетей, все они имеют общие черты. Так, все они, так же, как и мозг человека, состоят из большого...

-

В данной курсовой работе необходимо разработать алгоритм и программу на языке С# вычислительного процесса (двухслойная нейросеть). В наши дни возрастает...

-

Обучение с учителем и формальная запись задачи классификации Теория машинного обучения решает задачи предсказания будущего поведения сложных систем в том...

-

Методы Рунге-- Кутты-- важное семейство численных алгоритмов решения обыкновенных дифференциальных уравнений и их систем. Данные итеративные методы...

-

В этом разделе намеренно допущено отступление от общей методики - не смешивать разные компоненты. Это сделано для облегчения демонстрации построения...

-

Обучение нейронной сети Цель работы Изучить принципы проектирования и обучения нейронных сетей с помощью пакета Matlab. Изучить на практике работу...

-

Система мониторинга социальных сетей предоставляет исследователю возможность собрать интересующие его упоминания в социальных сетях по какой-либо...

-

В работе возникает необходимость выбора предметной области, в которой будет тестироваться каскадный классификатор. Главными вопросами на данном этапе...

-

Актуальность Сегодня всемирная популярность социальных информационных сетей продолжает набирать обороты, все большее пользователей не может отказать себе...

-

При разработке данной программы были допущены следующие синтаксические ошибки: - неправильное использование операторов присваивания; - неверное...

-

Непременным атрибутом офиса любой современной компании являются компьютеры. При наличии нескольких компьютеров практически всегда их объединяют в...

-

Обучение каскадного классификатора - Исследование алгоритмов

В OpenCV есть два приложения для тренировки каскадов URL: http://docs. opencv. org/modules/objdetect/doc/cascade_classification. html?...

-

Рассмотрим замкнутую сеть массового обслуживания с разнотипными заявками, которая является вероятностной моделью обслуживания заявок в УП "Проектный...

-

Основные понятия и определения Прежде чем приступить к обсуждению вопросов оптимизации, введем ряд определений и рассмотрим основные понятия. Оптимизация...

-

Поскольку в точке ветвления не происходит преобразования сигнала, то константа Липшица для нее равна единице. Сумматор Производная суммы по любому из...

-

Структура комплекса представлена на рисунке 3. Комплекс состоит из следующих модулей: - пользовательский интерфейс; - математическая модель; - библиотека...

-

Знакомство с нейронными сетями Цель работы Ознакомление со структурой нейронных сетей. Получение навыка программирования нейронных сетей. Теоретическое...

-

Описание SEIR-модели эпидемии Современные социальные информационные сети позволяют обмениваться различными видами мультимедийной информации среди ее...

-

В ходе выполнения курсовой работы на основе полученных знаний была решена система, описывающая модель SEIR распространения вирусов и проведено ее...

-

Онлайн исследования в социологии: новые методы анализа данных - Распространение новостной информации

На сегодняшний день анализ социальных сетей и медиа, Интернет-сообществ, пользователей в целом используется в основном в маркетинге. Компания может...

-

Для решения трехмерной задачи упругости с помощью метода конечных элементов были заданы следующие основные параметры: [1]. Количество секций. [2]....

-

Данная методика рассчитана на приложения с трехуровневой архитектурой: клиент - сервер приложений - сервер базы данных. Так как программа нацелена на...

-

Впервые последовательное описание конструирования нейронных с Етей из элементов было предложено в книге А. Н. Горбаня [65]. Однако за прошедшее время...

-

МЕТОДЫ ДОСТУПА К ПЕРЕДАЮЩЕЙ СРЕДЕ В ЛВС - Компьютерные сети и телекоммуникации

Несомненные преимущества обработки информации в сетях ЭВМ оборачиваются немалыми сложностями при организации их защиты. Отметим следующие основные...

-

Физическая среда передачи в локальных сетях - Методы доступа к передающей среде в ЛВС

Весьма важный момент - учет факторов, влияющих на выбор физической среды передачи (в ЛВС - кабельной системы). Среди них можно перечислить следующие:...

-

Исходные данные для разработки Сеть абонентского доступа разрабатывается согласно заданию на дипломный проект для территории, представленной на рисунке...

-

Методы разработки вычислительной сети: 1. Экспериментальный метод - персонал предприятия закупает "новинки" рынка компьютерной техники. Такой метод -...

-

Известные в литературе нейронные сети, в отличие от предлагаемой семантической информационной модели и нелокальных нейронных сетей, не обеспечивают...

-

Метод конечных элементов является численным методом для нахождения приближенных решений физических задач. В основе этого метода лежит разделение...

-

Геометрический метод, Двойственная задача - Линейное программирование

Применяется для задач с двумя переменными. Метод решения состоит в следующем: На плоскости строятся прямые, которые задают соответствующие ограничения:...

-

Как уже отмечалось в разделе "Различимость входных данных" числовые сигналы рекомендуется масштабировать и сдвигать так, чтобы весь диапазон значений...

-

Написать программу на С++ моделирующую двухслойную нейронную сеть структуры согласно варианту, указанному в таблице 4. Таблица 4 Варианты заданий для...

-

Введем начальные условия, необходимые для реализации метода Рунге-Кутта 4-го порядка: S(0)=100, E(0)=1, I(0)=0,R(0)=0, t=[0,30]. Параметры Sigma = 0.5 ;...

-

Сеть Петри это двудольный направленный граф с маркировкой, ребра которого задают причинно-следственные отношения "события-условия" и именуются дугами....

-

Во второй главе магистерской диссертации обобщены результаты исследования, проведенного с целью выявления возможностей и сложностей работы школьной...

-

Тестирование и отладка системы - Исследование и модернизация локальной вычислительной сети

Тестирование системы является одной из завершающих стадий в процессе проектирования. На этом этапе проверяется соответствие созданной распределенной...

-

Малоканальные системы уплотнения абонентских линий (АЛ) основаны на технологии DSL со скоростью потока 160 кбит/с. В масштабах крупных офисов (чаще всего...

-

Проектная часть - Исследование и модернизация локальной вычислительной сети

Анализ возможных вариантов построения Прежде всего, при проектировании ЛВС следует выбрать сетевую архитектуру и топологию. Архитектура сети определяет...

-

Описание предметной области - Разработка локальной сети для ОАО "Корпорация Монстров"

Непременным атрибутом малого предприятия являются компьютеры. При наличии нескольких компьютеров практически всегда их объединяют в локальную сеть....

-

Предложенный подход к решению задач исследования Используя в качестве основы присутствующее в наличии программное обеспечение, которое применимо к...

Обучение нейронной сети - Исследование метода обратного распространения ошибки для обучения нейронной сети